共創 AIと未知のじぶん

「入力→変換→出力」から考えるAIのしくみ

AIって何?

あなたは何と答えますか?AIって、ChatGPTとかGeminiとかでしょ?

そう答えてしまいそうですね。

AIって何だろう?

じぶんで考える間もなく、あなたは、すぐAIに質問してしまうのでは?

そして、それぞれのAIは、こんなふうに答えるかもしれません。

⚫︎ ChatGPT: AIとは、人間の質問や文章を受け取り、学習した大量のパターンをもとに、もっとも自然で役に立つ答えをつくるしくみです。考えているように見えますが、実際には入力を理解しやすい形に変え、次にふさわしい言葉を予測しています。

⚫︎ Gemini: AIとは、文章、画像、音声、動画などの情報を読み取り、それらの関係を見つけて、答えや提案を返すコンピュータのしくみです。検索や文章作成だけでなく、さまざまな情報を組み合わせて考える手助けをします。

⚫︎ Claude: AIとは、人間の言葉を受け取り、その文脈や意図を推測しながら、できるだけ役に立ち、安全でわかりやすい応答を返すシステムです。人間のような意識はありませんが、対話を通して考える手助けをします。

⚫︎ Copilot: AIとは、人間の作業を助けるために、情報を整理し、文章を書き、計算し、アイデアを出してくれるデジタルな相棒です。特に仕事や勉強の中で、必要な作業を早く、正確に進めるために使われます。

⚫︎ Perplexity: AIとは、大量の情報から関係を見つけ、質問に対して根拠のある答えを探して返すしくみです。特に、知りたいことを調べ、複数の情報源をもとに整理する時に役立ちます。

⚫︎ Grok: AIとは、人間が入力した言葉をもとに、ネットや学習データからパターンを見つけ、かなり速く答えを返すソフトウェアです。人間のように意識しているわけではありませんが、会話や情報整理をかなり自然にこなします。

これらの回答をまとめると、「AIとは、入力された情報を、学習済みのパターンと計算によって変換し、人間にとって意味のある出力として返すしくみ」です。

端的に言うと?

⚫︎ ことばを入れると、ことばが出てくる機械。

⚫︎ 質問すると何でも答えてくれるコンピュータ。

⚫︎ 画像生成、プログラミング、何でもできるスゴイやつ。

あなたの質問には、答えてくれたのでしょうか?でも、何をどうやってやっているのか、わかりませんね。

AIは、「謎の箱」ではありません。「入力、変換、出力」のしくみとして見ていきます。中学で習う関数から出発して、ベクトル、行列、確率、学習へとつなげながら、AIに何ができ、何ができないのかを考えてみましょう。

AIが何をしてくれるのかだけでなく、じぶんは何を入力し、何を受け取り、何を行動に変えるのか。そこに、共創AIの入口があります。

① 「書きことば」を出し入れする機械

AIとは、人間のことばを受け取り、それを内部で数のまとまりに変え、またことばとして返す人工的な変換システムです。質問を入れると答えてくれます。相談すると、考えてくれているように見えます。けれど、AIが人間のように理解し、考え、感じているわけではありません。入力されたものを内部で変換し、出力を返しているのです。

ここでいう「ことば」とは、基本的に書きことばです。音声入力もできます。でも、あなたの声音を直接聞いているのではありません。人間のように、声のトーン、間、リズム、息づかい、発音のくせを身体で聞いているのではなく、音声はいったん文字に直され、そのテキストがAIに渡されます。つまり、声で話しているように見えても、中心にあるのは、文字化されたことばの出し入れです。

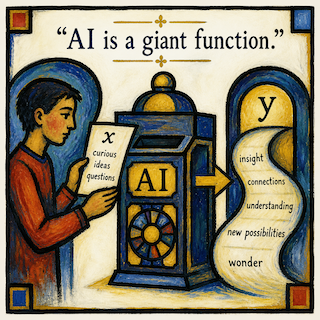

② AIは、関数

端的に表現するなら、AIは、関数。入力があり、内部の変換があり、出力があります。中学で習う関数「x を入れると y が出る」しくみですね。AIもまた、入力を受け取り、学習済みのしくみによって出力を返す関数です。ただし、それは一行で書ける単純な関数ではなく、非常に巨大な関数です。

AIは「答えをしまってある箱」ではありません。入力を受け取り、その入力に応じて内部で変換し、出力をつくるしくみです。別の言い方をすると、巨大な関数マシンです。

③ ことばを、ベクトルに変える

AIに入るものは、ひとつの数字ではありません。ことば、画像、音、行動、文脈などです。AIはそれらをそのまま扱うのではなく、比べたり計算したりできる数のまとまりに変えます。この数のまとまりをベクトル(vector)と呼びます。

ベクトルとは、ひとつの数ではなく、数の並び全体のことです。たとえば、

[0.12, -0.83, 1.45, 0.04]

のような数のまとまりです。このまとまり全体がベクトルです。その中の 0.12 や -0.83 は、ベクトルそのものではなく、ベクトルの成分です。(図形の矢印のことじゃないの?と思った人、じっくり読んでください)

たとえば、人の特徴を、身長、体重、年齢などの数値で表すことができます。同じように、AIはことばや画像や音を、多次元の特徴のまとまりとして表します。ベクトルを「特徴を運ぶもの」と考えると、わかりやすくなります。(Vectorの語源は「運ぶもの」です)

ことばは、ベクトル空間の中に置かれます。ベクトル空間とは、ベクトルを置き、近い、遠い、似ている、関係がある、といったことを計算できる見えない空間です。意味を説明文として持つのではなく、関係の中の位置として扱うための空間、と言ってもよいでしょう。

AI maps the world into a vector space.(AIは、世界をベクトル空間に配置するしくみ)

④ ことばの関係を計算する

現代のAI、とくにLLM(大規模言語モデル)は、入力されたテキストを小さな単位に分けます。この小さな単位をトークンと呼びます。トークンは、単語そのものとは限りません。単語より短いこともあれば、複数の文字のまとまりであることもあります。

AIは、そのトークンをベクトルとして扱います。そして、そのベクトルを何度も変換します。この変換を何層にも重ねるしくみを、ニューラルネットワークと呼びます。名前に「ニューラル」とありますが、人間の脳そのものではありません。脳の神経回路からヒントを得た、計算のしくみです。

私たちには、AIが答えを考えて一気に出しているように見えます。しかし実際には、次にふさわしいことばを連続的に生成しているのです。

⑤ 何を生成しているのか

よく「生成AI」と呼ばれます。一体、何を生成しているのでしょうか。

表面では、文章、画像、音声などを生成しています。しかし、文章生成AIの場合、直接生成しているのは文章全体ではありません。次に来る小さなことばの単位です。これをトークンと呼びます。

入力された文脈をもとに、AIは次に来る候補の確率分布をつくります。確率分布とは、「次にどのことばが来そうか」を候補ごとに並べたものです。その中からひとつを選びます。そのトークンを文脈に加え、また次のトークンを予測します。この順次生成の連続が、出口では文章として現れます。

つまり、文章生成は出口です。内部では、入力がベクトル空間に写され、文脈の関係が計算され、次に出すべき候補の確率分布がつくられます。AIがいきなり「意味」を丸ごと生成しているのではありません。内部表現を更新しながら、次に来ることばを順番に選び出しているのです。その結果が、人間には自然な文章として見えます。

⑥ 機械学習:自分で修正して、答えに近づく

AIのすごい点は、人間が一つひとつルールを教え込んだわけではないところにあります。これを支えているのが、機械学習です。

機械学習とは、コンピュータの中のモデルが、大量のデータを使いながら、自分の内部を調整していく方法です。

AIは答えを出します。その答えと、望ましい答えのズレを測ります。その誤差が小さくなるように、内部の重みを調整します。このくり返しによって、AIは自動的に役に立つ特徴表現を獲得していきます。

これは、人間の身体運動の練習にも似ています。

やってみる。ズレを知る。直す。くり返す。

ただし、人間には感覚、ねがい、記憶、意味づけがあります。AIにはそれがありません。

⑦ 一般には強いが、個別は知らない

だから、AIは一般的、平均的、常識的な情報には強いのです。大量のテキストに現れるパターンを学習しているからです。しかし、入力されていない個別固有のことはわかりません。あなたの人生、記憶、声、ふるまい、願い、変化を直接知っているわけではありません。個別に見える答えも、多くは一般的な情報からの推定です。

AIは、あなたを理解して考えているわけではありません。あなたにとって、理解して考えて答えているように感じられる出力を返しているのです。AI、Artificial Intelligence という名のとおり、人工的な、つまり人間がつくった「知能らしさ」です。

⑧ AIの土台は、中学生の数学

AIの土台は数学です。そして、その入口は、中学で習う関数です。

AIには、いくつもの分野が重なっています。線形代数は、ことばや画像や音を、ベクトルや行列という数の形で表し、変換するための数学です。確率・統計は、「次に何が来そうか」「どの答えがどれくらいありそうか」を扱うための数学です。

機械学習(Machine Learning)は、コンピュータの中のモデルが、データを使って自分の内部の重みを調整し、答えのズレを小さくしていく方法です。コンピュータサイエンスは、その膨大な計算を高速に動かすための技術です。そして、何のためにAIを使うのかを決めるのは、人間の目的や社会の文脈です。

機械学習という名前ですが、ここでいう「機械」は、ロボットのような機械ではありません。コンピュータの中のモデルのことです。そのモデルが、たくさんのデータを使い、答えのズレが小さくなるように、自分の中の重みを調整していく。それが機械学習です。

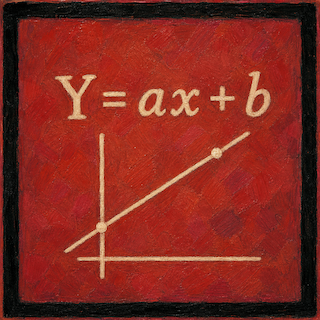

けれど、入口は関数です。

関数とは、ある入力に対して、ひとつの出力を対応させるしくみです。x を入れると、y が出る。一次関数 y = ax + b では、入力 x が変わると、出力 y がどう変わるかを量として表します。x が入力、y が出力、a が変化のしかた、b が調整分です。

AIも、この延長にあります。入力を受け取り、内部で変換し、出力を返します。ただし、AIに入る x は、ひとつの数ではありません。ことば、画像、音、文脈などです。それらを、たくさんの数のまとまりとして扱います。つまり、先ほど出てきた、ベクトル(vector)です。

ベクトルとは、本来、ひとつの数では表せない量を、いくつもの数の組として表す方法です。たとえば、人を身長、体重、年齢などで表すとします。

[身長, 体重, 年齢]

このように、複数の特徴を数字として並べたものも、ベクトルです。ひとことで言えば、ベクトルとは、特徴を数字にして載せたリストです。vector という語には、もともと「運ぶもの」という意味があります。ベクトルは、特徴を運ぶものだと考えると、わかりやすくなります。

学校でベクトルというと、図形の矢印として出てくることが多いでしょう。向きと大きさを持つ矢印です。しかし、矢印はベクトルの一つの表し方です。ベクトルの本質は、ひとつの数では表せない量を、複数の数で表すところにあります。

AIで使うベクトルも、同じです。ことばや画像や音を、特徴のリストとして表します。たとえば、あることばを、意味、文脈、使われ方、近いことばとの関係などを含む、多次元の数のまとまりとして表します。これが、AIにおけるベクトルです。

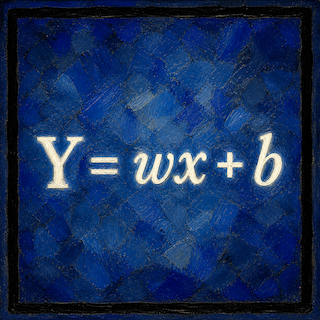

そして、そのベクトルを別の形に変えるしくみが、行列(matrix)です。

行列というと、日常では「人が列に並ぶこと」を思い浮かべるかもしれません。しかし数学でいう行列は、数字を縦横に並べた表です。この表は、ベクトルを別のベクトルに変える働きをします。つまり、行列は変換表です。

中学の一次関数では:

x → a をかける → y

AIでは:

特徴のリスト → 変換表で変える → 新しい特徴のリスト

になります。

x がひとつの数なら、a というひとつの数で変えられます。でも、x がたくさんの数のまとまりなら、a ひとつでは足りません。たくさんの特徴を同時に変える、大きな数字の表が必要になります。それが行列、つまり matrix です。

この変換を一回ではなく、何層にも重ねます。すると、最初はただの文字の並びだったものが、文脈の手がかりになり、意味の関係になり、次に来ることばの予測につながっていきます。

つまり、AIは、入力と出力の関係を量として扱うしくみです。中学で習う関数の考え方が、ベクトル、行列、確率、統計、最適化へと広がり、現代のAIにつながっています。

⑨ なぜ、AIは謎の箱に見えるのか

AIは、突然現れた神秘の箱ではありません。入力と出力の関係を量として扱うしくみです。何が入り、どう変換され、何が出てくるのか。それは、中学で習った関数の考え方からつながっています。それでも多くの人にとって、AIは謎の箱のように見えます。

理由のひとつは、学校で学んだ数学の線が、AIのしくみにまでつながって見えにくいからです。

関数は習った。ベクトルも習った。確率や統計も習った。しかし、それらが「入力を数のまとまりにし、変換し、確率的に出力するしくみ」としてつながって見えない。

ベクトルは矢印として学ぶ。行列は学ばないか、学んでもAIとの関係が見えにくい。確率はサイコロやくじの話に見える。統計は平均や偏差値の話に見える。そのため、AIが「ことばをベクトルにし、行列で変換し、確率で次のことばを選ぶ」と聞いても、自分が学んだ数学とつながりにくいのです。

ここでいう「謎の箱」とは、原理への入口が見えないという意味です。何が入って、何が変換され、何が出てくるのか。その基本の流れが見えないために、AIが魔法のように感じられてしまうのです。

しかし本来は、入口があります。AIは魔法ではありません。入力があり、変換があり、出力があります。その変換を、数学で大きく、細かく、何層にもしたものです。

AIをわかるとは、すべての計算を追うことではありません。まず、入力、変換、出力という流れをつかむことです。その流れが見えるだけでも、AIはただ依存する相手ではなく、理解し、問い直し、使う道具になります。

⑩ 原理はある。でも、すべては追いきれない

AIは、人間が設計したしくみです。アルゴリズムも、学習の方法も、モデルの構造も、人間が考えてつくってきました。けれど、人間がつくったからといって、その中で起きていることを人間がすべて追えるわけではありません。

Geoffrey Hinton博士は、現代AIの基礎をつくった代表的な研究者です。そのHinton博士でさえ、AIについて、人間はアルゴリズムを設計したが、その内部で何が起きているのか、またAIがどのようにふるまうのかを完全には見通せない、と語っています。

これは「何もわからない」という意味ではありません。車が人間より速く走ることに、私たちは驚きません。車がどういう原理で走るかを、完全な部品レベルで知らなくても、燃料や電気を使い、エンジンやモーターで動力に変え、車輪を回すという基本は理解できます。コンピュータも同じです。電子の速度で計算するため、人間には到底追えない量の処理を瞬時に行います。

AIも同じです。基本原理はあります。入力を数のまとまりに変える。何層にも変換する。確率的に次の候補を選ぶ。誤差を小さくするように学習する。ここまでは説明できます。

しかし、ある一つの質問に対して、なぜその一語が選ばれ、その次にその一文が続いたのかを、人間がすべてたどることはできません。計算が巨大すぎるからです。

つまり、AIは「原理がわからない神秘」ではありません。原理はわかるが、全過程は追いきれない巨大な関数です。

だからこそ、基本を知る意味があります。AIに何ができるのか。何ができないのか。どこから先は推定なのか。何が入力されていなければ答えられないのか。そうしたことを見分けるためには、AIが魔法ではなく、入力と出力の関係を学習したしくみだと知っておく必要があります。

AIをわかるとは、AIのすべてを見通すことではありません。確実に言えることと、見通せないことを分けることです。そこから、AIをただ信じるのではなく、使い方を考えることができます。

⑪ AIは代わりに生きてはくれない

AIには身体がありません。それはもとよりです。しかし、ことばのやりとりにおいても、人間なら自然にしているふるまいが、そのまま備わっているわけではありません。

黙ってうなずく。「あ、それそれ」と、相手の言葉をいっしょに見つける。答えを急がず、問いをそのまま抱えて待つ。

AIがそうした反応を返すことはできます。しかし、それは人間のように気配を感じているからではありません。そう見える言葉を、入力に応じて生成しているのです。

AIは、人間の代わりに生きるものではありません。人間が問い、受け止め、使い、行動に変えることで、はじめて意味を持つ道具です。

まとめ

AIとは、入力を受け取り、学習済みの関係にもとづいて出力を返す巨大な関数です。ことばをベクトル空間に置き、多層の計算で変換し、次にふさわしいことばを確率的に順次生成します。出口では、それが文章として現れます。

人間のように考えているのではありません。しかし、人間にはそのように見えます。その「考えているように見える」人工的なしくみこそが、AIです。

AIをわかるとは、AIに依存することではありません。入力と出力の関係を見つめ、自分が何を入れ、何を受け取り、それをどう行動に変えるかを考えることです。

補足A:共創AIは、あなたのデータから始まる

AIは、入力されていないことを知ることができません。テキストでプロンプトを入れなければ、AIにはあなたの呼吸、声の調子、表情、間、迷い、ふるまいはわかりません。あなたが何を試し、どこでつまずき、どう直そうとしたのかも、記録されなければ学習のしようがありません。

人間の活動の多くは、意識されないところで起きています。声の出し方、間の取り方、身体の反応、ためらい、くり返し、失敗のしかた。テキストとして考えて入力するものは、そのごく一部です。だから、一般的なAIは、文章づくりや情報整理には強くても、あなた固有の変化や、かけがえのない経験そのものには、まだ十分に近づけません。

エンパシームは、そこに取り組むためのしくみです。肉声の特徴を捉え、可視化し、視覚化します。声の長さ、強さ、リズム、間、変化を、見える形にします。また、結果だけでなく、日々のふるまい、続け方、つまずき、変化の流れも〈見える化〉します。

大切なのは、スコアだけではありません。結果だけを見ても、その人がどのように変わったのかは見えません。どこで失敗したのか。どう直そうとしたのか。何度くり返したのか。どんな言葉に励まされたのか。どんな時に続き、どんな時に止まったのか。そうしたプロセスに、その人固有の学びがあります。

つまり、かけがえのないあなた固有のことについてAIの助けを得るには、あなた自身のプラクティスが必要です。あなたの声、ふるまい、くり返し、気づき、変化がデータになります。そのデータがあってはじめて、AIは一般論ではなく、あなたに近い手助けに近づくことができます。

ここでいう共創AIとは、AIが一方的に答えをくれるものではありません。あなたが実践し、その結果や過程を残し、AIがそれを映し返し、次の実践につなげる。あなたとAIがともにデータをつくり、ともに学びの場をつくるものです。

このラボで行うのは、単にAIを使うことではありません。みんなのプラクティスを通して、親身になってくれるAIそのものを育てることです。あなたの声、あなたのふるまい、あなたの変化が、AIにとっての新しい入力になります。そして、その入力が蓄積されることで、AIは少しずつ、あなたや仲間の学びに寄り添えるようになります。

エンパシームは、その見えない線を見えるようにするための実践です。声をうつす。ふるまいをうつす。変化をうつす。そうして、いちばん身近で、いちばん未知である「じぶん」を探っていきます。

⚫︎ エンパシームは、目に見えない声やふるまいを見える形にするテクノロジーと、それを毎日の実践に組み込んだしくみ。

⚫︎ 同時に、ユーザー、指導者・チューター、研究者、クリエイターが参加し、みんなのプラクティスを支えるプラットフォーム。

⚫︎ あなたの声を、色や形、リズムとして手のひらにのせる。あなたのプラクティスデータをあなた自身が体験し、変化に気づく。

⚫︎ エンパレットも活用します。サイエンス・アート・テクノロジー・プラクティスをつなぐ、学びのコンテンツと創作ツール。

⚫︎ Rhythm Mirror®、Hearing Mirror®、Context Mirror®、Empathy Interface®、Empathetic AI KurageSan®

補足B:偶然出会ったことばが、あなたのふるまいになるまで

AIは、入力を受け取り、内部で変換し、出力を返すしくみです。

では、人間はどうでしょうか。

人間にも、入力、変換、出力があります。ただし、それは機械の計算ではありません。ことば、声、出会い、出来事が入り、心と身体の中で変わり、ふるまいとして外に現れます。その流れを、次のように見ることができます。

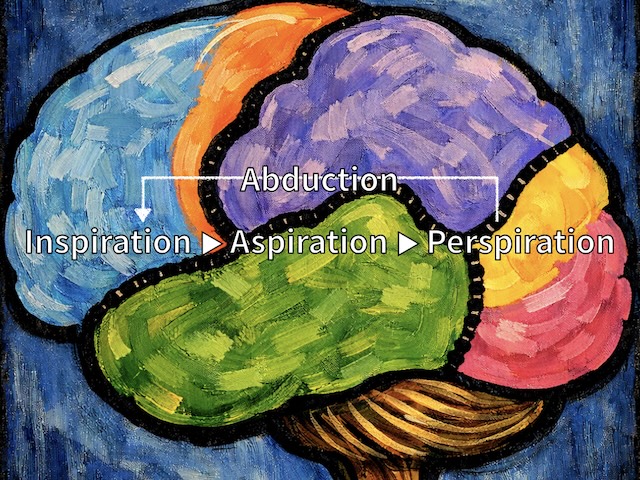

⚫︎ Inspiration:外から入ってくるひらめき。偶然、出会うことば。誰かの声、出来事、風景、読んだ一文。毎日の営みの中で、ふいに入ってくるものです。

⚫︎ Aspiration:それを、じぶんの内から発するねがいに変えること。「こうありたい」「やってみたい」「もう一度試したい」という内側の動きです。心の中で、Inspiration が Aspiration に変換されます。

⚫︎ Perspiration:そのねがいが、身体を通ってふるまいになることです。声に出す。書く。歩く。練習する。つくる。続ける。文字通り、汗をかくこと、努力の発揮です。

Respiration その全体を支える呼吸です。くり返し、整え、続けるリズムです。息をするように、実践は一度で終わらず、また戻り、また始まります。そして、あとからふりかえる時、私たちは、出会ったことば、発したねがい、実際のふるまいのあいだに、線を見出します。

なぜ、あの言葉が忘れられなかったのか。 なぜ、あの時、やってみようと思ったのか。 なぜ、あの小さな行動が、次の自分につながったのか。点と点をつなぎ、意味に気づくこと。これを Abduction、つまり「あとから遡って気づくこと」と呼ぶこともできます。

AIのしくみは、入力 → 変換 → 出力 です。

人間の実践にも、似た流れがあります。

⚫︎ Inspiration → Aspiration → Perspiration → Abduction

外から入ったことばが、内側のねがいになり、身体を通したふるまいになり、あとから気づきとして結ばれる。

ここに、共創AIの入口があります。AIに答えを出してもらうだけではありません。じぶんが出会い、ねがい、ふるまい、ふりかえる。その実践の流れを、AIとともに見えるようにしていくことです。

Aspiration の語根には、「息」があります。同じ仲間に inspiration, respiration, perspiration, spirit があります。Inspiration は、息を吹き込まれること。そこから、ひらめき。Respiration は、呼吸。Perspiration は、汗をかくこと。皮膚を通して息がにじみ出る、という感覚です。Spirit も、もとは息、生命の息です。息は、ただの空気ではなく、いのちの動きとして感じられてきました。これらは、語源が近いというだけではありません。ひとつの流れ、くり返しのサイクルとして見ることもできます。

補足C:AIの先人

AIは、ひとつの発明から生まれたものではありません。数学、統計、機械学習、コンピュータサイエンス、そして実際に使う現場の目的が重なって生まれたものです。

AIにつながる先人たちを、ここではいくつかの流れに分けて見てみます。

❶ 関数と変換の流れ

⚫︎ルネ・デカルト:座標の発明。図形を数で表す道を開いた。

⚫︎ゴッドフリート・ライプニッツ: 微積分と関数の発明。変化する量どうしの関係を数学で扱った。

⚫︎レオンハルト・オイラー: 関数記法 f(x) の普及。関数を数学の中心的な道具にした。

❷ ベクトルと行列の流れ

⚫︎ヘルマン・グラスマン:多次元量の数学化。ベクトル空間につながる考えを開いた。

⚫︎ジェームズ・シルベスター:matrix という言葉の導入。行列を数学の対象として扱う道を開いた。

⚫︎アーサー・ケイリー:行列計算の体系化。行列を変換の合成として扱えるようにした。

❸ 確率と統計の流れ

⚫︎トーマス・ベイズ:確率更新の考え。新しい情報によって見方を更新する道を開いた。

⚫︎ピエール=シモン・ラプラス:確率的推論の発展。不確実な世界を数学で扱った。

⚫︎カール・フリードリヒ・ガウス:誤差と正規分布の数学化。測定と推定の基礎を築いた。

❹ 計算機とアルゴリズムの流れ

⚫︎アラン・チューリング:計算概念の定式化。コンピュータ理論の基礎をつくった。

⚫︎ジョン・フォン・ノイマン:コンピュータ構成の定式化。プログラム内蔵型コンピュータの基礎を築いた。

❺ 機械学習と深層学習の流れ

⚫︎フランク・ローゼンブラット:パーセプトロンの発明。ニューラルネットワークの原型を示した。

⚫︎デイヴィッド・ラメルハート、ジェフリー・ヒントン、ロナルド・ウィリアムズ:

誤差逆伝播の確立。ネットワークが誤差から学ぶ方法を示した。⚫︎ヤン・ルカン、ヨシュア・ベンジオ、ジェフリー・ヒントン:

深層学習の確立。多層ニューラルネットワークを現代AIの中心にした。⚫︎トマス・ミコロフら:Word2Vec の発明。ことばをベクトル空間で扱う方法を広めた。

⚫︎アシシュ・ヴァスワニら:Transformer の発明。現在の大規模言語モデルの基盤をつくった。

AIは、数学をベースに、統計学、機械学習、コンピュータサイエンス、そして人間の目的が重なって働くしくみです。

⚫︎ 関数(入力と出力の関係を表す)

⚫︎ 線形代数(ベクトルと行列で、多次元の量と変換を扱う)

⚫︎ 確率・統計(不確実な中で、次に何が起きそうかを考える)

⚫︎ 機械学習(データから、重みや特徴表現を自動的に調整する)

⚫︎ コンピュータサイエンス(膨大な計算を実際に動かす)

⚫︎ ビジネス・教育・医療・社会の現場など(AIを何のために、どう使うかを考える)

出典・参照:以下の論文、エンパレットなど

(1) 深層学習の全体像

Yann LeCun, Yoshua Bengio, Geoffrey Hinton “Deep Learning” Nature, 2015

https://www.nature.com/articles/nature14539

深層学習とは何かを大きく整理した代表的な総説論文です。多層のニューラルネットワークが、画像、音声、ことばなどのデータから特徴表現を学習できることを示し、現代AIの全体像を位置づけています。

(2) 誤差を小さくして学習する

David E. Rumelhart, Geoffrey E. Hinton, Ronald J. Williams “Learning representations by back-propagating errors” Nature, 1986 https://www.nature.com/articles/323533a0

ニューラルネットワークが、自分の出した答えと望ましい答えのズレを測り、その誤差が小さくなるように内部の重みを調整する方法を示した重要論文です。これが誤差逆伝播、back-propagation です。本文の「やってみる、ズレを知る、直す、くり返す」に対応します。

(3) ことばをベクトル空間に置く

Tomas Mikolov, Kai Chen, Greg Corrado, Jeffrey Dean “Efficient Estimation of Word Representations in Vector Space” arXiv, 2013 https://arxiv.org/abs/1301.3781

単語を、意味の近さや関係を計算できるベクトルとして表す方法を示した論文です。いわゆる Word2Vec の基礎です。単語の意味を辞書的な説明として持つのではなく、文脈の中でどのことばと近く現れるかによって、数のまとまりとして表します。本文の「ことばをベクトル空間に置く」という説明の中心にあります。

(4) 予測と文脈計算の基盤、Transformer

Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan N. Gomez, Łukasz Kaiser, Illia Polosukhin “Attention Is All You Need” NeurIPS, 2017 https://arxiv.org/abs/1706.03762

現在のLLMの基盤となった Transformer を提案した論文です。文章の中で、どのことばがどのことばに関係しているかを attention によって計算します。論文では、再帰構造や畳み込みを使わず、attention mechanism を中心にした Transformer を提案したと説明されています。ChatGPT、Gemini、Claude などの大規模言語モデルの基礎にあります。

(5) Hinton博士について

Geoffrey Hinton博士は、現代AI、特に深層学習の基礎をつくった代表的な研究者です。John Hopfield博士とともに、人工ニューラルネットワークによる機械学習を可能にした基礎的発見と発明によって、2024年のノーベル物理学賞を受賞しました。また、Yoshua Bengio博士、Yann LeCun博士とともに、深層ニューラルネットワークを現代コンピューティングの中核にした功績で、2018年のチューリング賞も受賞しています。